学术论坛

- 人工智能生成艺术论坛

- 复杂交通场景感知技术及其前沿应用论坛

- 文字识别与文档智能论坛

- 三维感知与显示技术论坛

- 视觉质量感知与评估前沿论坛

- 流程工业智能视觉感知技术论坛

- 情感计算大模型论坛

- 持续学习的理论与应用论坛

- 智能影像增强与可控内容生成论坛

- 多模态智能模型安全隐患洞察与防护论坛

- 空天探测成像前沿论坛

- 高效视频通信中的语义编码与内容增强论坛

- 智能图像感知微系统论坛

- 面向精神健康促进的具身交互智能研究论坛

- 工业视觉智能检测技术前沿论坛

- 面向具身智能的图像图形技术

- 生物特征识别论坛

- 大模型的表征学习与编码通信论坛

- 大模型复杂场景理解与轻量化应用论坛

- 视频动作理解与生成前沿论坛

- 生物医学成像与人工智能论坛

- 开放环境无人驾驶“感-通-算”前沿技术论坛

- 智能视觉传感信号处理论坛

- NeRF与3DGS智能生成技术探索论坛

- 深空探测人工智能技术论坛

- 生成式视频通信论坛

- 类脑计算、感知和智能论坛

- 多模态大模型应用安全与生成式人工智能监管论坛

- 多模态遥感大模型及应用论坛

- 机器视觉与学习论坛

- 具身智能感知交互论坛

- 规模化与轻量化协同演进技术论坛

- 空间计算前沿技术论坛

- 人脑影像图谱与人工智能论坛

- 低代价高质量信息智能获取论坛

- 工业具身智能感知前沿论坛

多模态智能模型安全隐患洞察与防护论坛

论坛简介

随着人工智能技术的迅猛发展,多模态智能模型已经在图像识别、自然语言处理、语音识别等多个领域取得了显著成果,并逐渐渗透到社会生活的各个角落。然而,这些复杂模型在为人类带来便利的同时,也引发了新的安全挑战与隐患,如对抗样本攻击、隐私泄露、深度伪造等。为了应对这些问题,2025中国图象图形大会特设立“多模态智能模型安全隐患洞察与防护”专题论坛,旨在探讨当前多模态智能模型所面临的多种安全隐患及其可能的防护方案。论坛将邀请来自学术界和工业界的顶尖专家进行主题演讲,分享他们在多模态智能模型安全性研究方面的最新进展。通过本次论坛,我们期望能够促进跨学科的合作,激发创新思维,推动构建更加安全可靠的多模态智能模型系统。

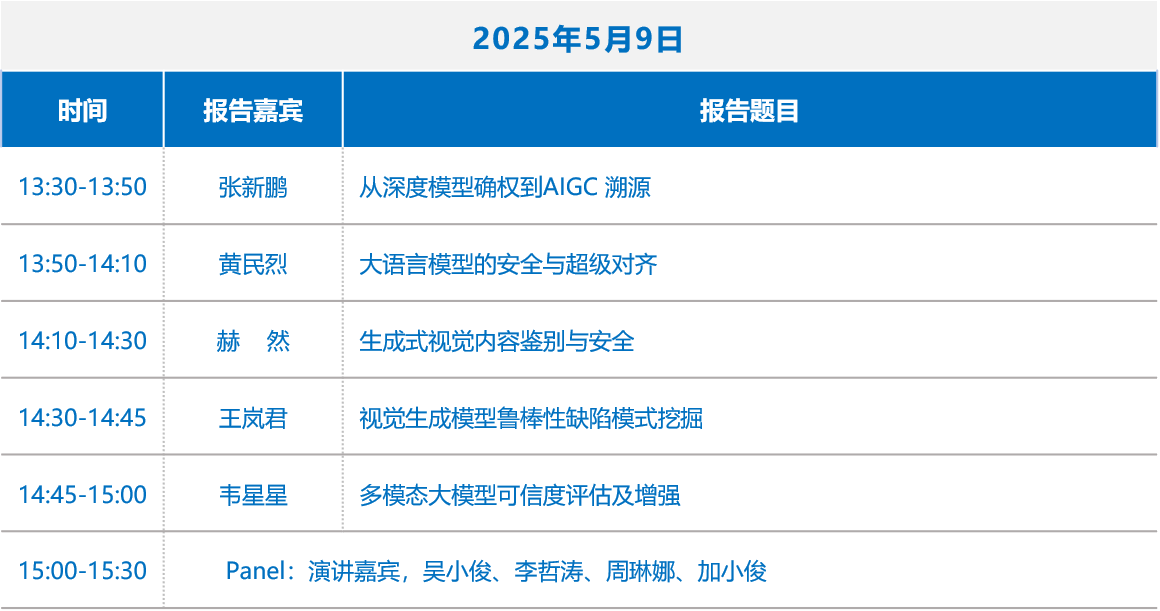

论坛日程

论坛时间:2025年5月9日13:30-15:30

论坛名称:多模态智能模型安全隐患洞察与防护论坛

主持人:任文琦,刘安安

论坛主席

-

任文琦中山大学 教授个人简介: 任文琦,教授,中山大学“百人计划”引进人才,主持国家自然科学优秀青年基金,天津大学与美国加州大学Merced分校联合培养博士,从事计算机视觉与多媒体内容安全领域的研究。在CCF-A类期刊和会议长文发表学术论文70余篇(6篇ESI高被引论文,2篇热点论文),Google学术引用12000余次,入选2022/2023爱思唯尔中国高被引学者。多次担任CVPR、ICLR、AAAI等AI和CV领域重要学术会议的领域主席和高级程序委员会委员。主持国家自然科学基金4项,深圳市优秀科技创新人才培养项目,华为、腾讯等企业合作项目。获中国计算机学会优博奖、吴文俊人工智能优秀青年奖、中国图象图形学学会自然科学一等奖(3/5)。 -

刘安安天津大学 教授个人简介: 刘安安,国家杰青,天津市数字安防中心副主任,天津大学图像所所长。作为负责人承担国家基金联合重点、重点研发课题等;以第一完成人获天津市科技进步特等奖;发表IEEE/ACM汇刊、CCF-A类国际会议等高水平论文百余篇;入选IET Fellow、爱思唯尔高被引学者等,担任4个IEEE/ACM期刊编委,连续6年担任CCF-A类国际会议ACM Multimedia领域主席。

刘安安天津大学 教授个人简介: 刘安安,国家杰青,天津市数字安防中心副主任,天津大学图像所所长。作为负责人承担国家基金联合重点、重点研发课题等;以第一完成人获天津市科技进步特等奖;发表IEEE/ACM汇刊、CCF-A类国际会议等高水平论文百余篇;入选IET Fellow、爱思唯尔高被引学者等,担任4个IEEE/ACM期刊编委,连续6年担任CCF-A类国际会议ACM Multimedia领域主席。

论坛讲者信息

-

张新鹏复旦大学 教授报告题目: 从深度模型确权到AIGC溯源报告摘要: 随着AI技术的不断进步,大模型在不同领域展现出巨大的潜力,但同时也面临各种风险问题。一方面,大模型昂贵的开发成本,对模型非法窃取与传播将严重损害模型持有者的正当权益。另一方面,利用AIGC技术生成逼真的虚假照片、视频和声音等信息可能被别有用心者用于操纵公众舆论、捏造虚假宣传、抹黑商业对手、诋毁个人名誉甚至实施精准欺诈。模型水印技术作为一种主动防御手段,近年来被广泛应用于深度模型的版权保护和生成内容溯源。本报告将介绍深度学习模型水印的发展历程,探讨判别式模型水印和生成式模型水印的核心问题和面临的挑战,展望AIGC水印发未来发展。个人简介: 张新鹏,国家杰出青年科学基金获得者,二级教授。入选上海市东方英才计划领军项目、上海市优秀学术带头人、上海市曙光人才计划、上海市“东方学者”跟踪计划、上海市浦江人才计划、上海市“青年科技启明星”跟踪计划。曾赴美国纽约州立大学宾汉顿分校访问一年,受德国洪堡基金会资助作为资深研究员赴德国康斯坦茨大学访问14 个月。主持国家自然科学基金重点项目、国家自然科学基金原创探索项目、国家重点研发计划项目、国家863计划等科研项目40余项。发表论文400余篇,被引20000余次,2014年—2023年连续十年入选“爱思唯尔”中国高被引学者榜单,2020年入选“科睿唯安”全球高被引科学家。申请发明专利40余项,授权近30项。获上海市自然科学奖一等奖、国家级教学成果二等奖。担任 IEEE Trans. on Information Forensics and Security (IEEE T-IFS)等国际学术期刊的 Associate Editor、ACM IH&MMSec 和IEEE WIFS等国际学术会议的主席。

张新鹏复旦大学 教授报告题目: 从深度模型确权到AIGC溯源报告摘要: 随着AI技术的不断进步,大模型在不同领域展现出巨大的潜力,但同时也面临各种风险问题。一方面,大模型昂贵的开发成本,对模型非法窃取与传播将严重损害模型持有者的正当权益。另一方面,利用AIGC技术生成逼真的虚假照片、视频和声音等信息可能被别有用心者用于操纵公众舆论、捏造虚假宣传、抹黑商业对手、诋毁个人名誉甚至实施精准欺诈。模型水印技术作为一种主动防御手段,近年来被广泛应用于深度模型的版权保护和生成内容溯源。本报告将介绍深度学习模型水印的发展历程,探讨判别式模型水印和生成式模型水印的核心问题和面临的挑战,展望AIGC水印发未来发展。个人简介: 张新鹏,国家杰出青年科学基金获得者,二级教授。入选上海市东方英才计划领军项目、上海市优秀学术带头人、上海市曙光人才计划、上海市“东方学者”跟踪计划、上海市浦江人才计划、上海市“青年科技启明星”跟踪计划。曾赴美国纽约州立大学宾汉顿分校访问一年,受德国洪堡基金会资助作为资深研究员赴德国康斯坦茨大学访问14 个月。主持国家自然科学基金重点项目、国家自然科学基金原创探索项目、国家重点研发计划项目、国家863计划等科研项目40余项。发表论文400余篇,被引20000余次,2014年—2023年连续十年入选“爱思唯尔”中国高被引学者榜单,2020年入选“科睿唯安”全球高被引科学家。申请发明专利40余项,授权近30项。获上海市自然科学奖一等奖、国家级教学成果二等奖。担任 IEEE Trans. on Information Forensics and Security (IEEE T-IFS)等国际学术期刊的 Associate Editor、ACM IH&MMSec 和IEEE WIFS等国际学术会议的主席。 -

黄民烈清华大学 教授报告题目: 大语言模型的安全与超级对齐报告摘要: 随着ChatGPT、GPT-4等大语言模型的智能水平的提升,通用人工智能也越来越接近。但“越智能越危险”,大语言模型的安全性研究变得越来越重要:偏见歧视、隐私、滥用、伦理、价值观等各种安全性问题成为广泛关注的问题,人工智能治理也成为智能社会的亟待规范的课题。讲者将围绕大语言模型尤其是中文大语言模型、对话系统的安全性和超级对齐问题,阐述其在弱到强泛化(weak-to-strong generalization)、规模化监督(scalable oversight)、精确对齐、模型权重外插、自动检测与自动对齐等方面的工作。个人简介: 黄民烈,清华大学长聘教授,国家杰青,清华基础模型中心副主任,中文信息学会理事、大模型与生成专委会副主任,CCF学术工委秘书长,聆心智能创始人,首席科学家。长期从事自然语言生成、大模型、大模型安全、社交智能等研究,多次主持国家重大项目包括重点研发、重点项目等。连续多年入选Elsevier中国高被引学者,AI 2000全球最有影响力AI学者榜单。曾获得中国人工智能学会吴文俊人工智能科技进步奖一等奖,钱伟长中文信息处理技术发明奖,电子学会科技进步奖一等奖,中文信息学会汉王青年创新奖等。研发多个对话大模型,包括心理大模型Emohaa、CharacterGLM等。

黄民烈清华大学 教授报告题目: 大语言模型的安全与超级对齐报告摘要: 随着ChatGPT、GPT-4等大语言模型的智能水平的提升,通用人工智能也越来越接近。但“越智能越危险”,大语言模型的安全性研究变得越来越重要:偏见歧视、隐私、滥用、伦理、价值观等各种安全性问题成为广泛关注的问题,人工智能治理也成为智能社会的亟待规范的课题。讲者将围绕大语言模型尤其是中文大语言模型、对话系统的安全性和超级对齐问题,阐述其在弱到强泛化(weak-to-strong generalization)、规模化监督(scalable oversight)、精确对齐、模型权重外插、自动检测与自动对齐等方面的工作。个人简介: 黄民烈,清华大学长聘教授,国家杰青,清华基础模型中心副主任,中文信息学会理事、大模型与生成专委会副主任,CCF学术工委秘书长,聆心智能创始人,首席科学家。长期从事自然语言生成、大模型、大模型安全、社交智能等研究,多次主持国家重大项目包括重点研发、重点项目等。连续多年入选Elsevier中国高被引学者,AI 2000全球最有影响力AI学者榜单。曾获得中国人工智能学会吴文俊人工智能科技进步奖一等奖,钱伟长中文信息处理技术发明奖,电子学会科技进步奖一等奖,中文信息学会汉王青年创新奖等。研发多个对话大模型,包括心理大模型Emohaa、CharacterGLM等。 -

赫然中国科学院自动化研究所 研究员报告题目: 生成式视觉内容鉴别与安全报告摘要: 生成式人工智能通过机器学习从数据中学习特征并生成全新数据,标志着AI从感知世界向创造世界的跃迁。然而,随着生成式人工智能的快速发展,网络攻击、虚假信息传播等安全问题日益凸显,为网络空间安全带来了新的挑战。本报告将介绍针对生成式人工智能系统的多模态内容检测与安全的研究现状,重点讨论高风险领域生成式人工智能系统生成内容的安全隐患、检测评价指标体系以及生成内容全生命周期的生成、鉴别与取证技术等。个人简介: 赫然,中科院自动化所多模态人工智能系统全国重点实验室研究员,IAPR/IEEE Fellow。从事人工智能、模式识别和计算机视觉研究。承担国家青年科学基金ABC类以及北京杰出青年科学基金等项目。在本领域国际主流期刊TPAMI和IJCV上发表论文23篇,第一作者11篇论文引用过百;研究工作获CAAI技术发明一等奖、CSIG自然科学一等奖、北京市科技进步二等奖等。指导学生获得IEEE SPS最佳青年论文奖、ICPR最佳科学论文奖、北京市优秀博士论文、中科院优秀博士论文、IEEE生物特征理事会优秀博士论文。曾/现担任IEEE TPAMI\TIFS\TIP\TCSVT\TBIOM、IJCV\PR\TMLR和自动化学报等国内外期刊编委,以及NIPS\ICML\ICCV\CVPR\ECCV\ICLR\AAAI\IJCAI等会议领域主席。2019年受邀参加庆祝中华人民共和国成立70周年大会天安门广场观礼。

赫然中国科学院自动化研究所 研究员报告题目: 生成式视觉内容鉴别与安全报告摘要: 生成式人工智能通过机器学习从数据中学习特征并生成全新数据,标志着AI从感知世界向创造世界的跃迁。然而,随着生成式人工智能的快速发展,网络攻击、虚假信息传播等安全问题日益凸显,为网络空间安全带来了新的挑战。本报告将介绍针对生成式人工智能系统的多模态内容检测与安全的研究现状,重点讨论高风险领域生成式人工智能系统生成内容的安全隐患、检测评价指标体系以及生成内容全生命周期的生成、鉴别与取证技术等。个人简介: 赫然,中科院自动化所多模态人工智能系统全国重点实验室研究员,IAPR/IEEE Fellow。从事人工智能、模式识别和计算机视觉研究。承担国家青年科学基金ABC类以及北京杰出青年科学基金等项目。在本领域国际主流期刊TPAMI和IJCV上发表论文23篇,第一作者11篇论文引用过百;研究工作获CAAI技术发明一等奖、CSIG自然科学一等奖、北京市科技进步二等奖等。指导学生获得IEEE SPS最佳青年论文奖、ICPR最佳科学论文奖、北京市优秀博士论文、中科院优秀博士论文、IEEE生物特征理事会优秀博士论文。曾/现担任IEEE TPAMI\TIFS\TIP\TCSVT\TBIOM、IJCV\PR\TMLR和自动化学报等国内外期刊编委,以及NIPS\ICML\ICCV\CVPR\ECCV\ICLR\AAAI\IJCAI等会议领域主席。2019年受邀参加庆祝中华人民共和国成立70周年大会天安门广场观礼。 -

王岚君天津大学 研究员报告题目: 视觉生成模型鲁棒性缺陷模式挖掘报告摘要: 随着DALLE-2、Midjourney、Sable Diffusion等成熟的商业模型不断问世,跨模态视觉内容生成技术为内容创作提供了新机遇,但也带来了生成内容安全的挑战。本报告从系统性的回顾针对视觉生成模型的对抗攻击方法出发,揭示视觉生成模型鲁棒性缺陷的三种模式,展示缺陷模式带来的内容生成风险,以及在相应风险防范措施上的思考。个人简介: 王岚君,天津大学新媒体与传播学院研究员,博士生导师,研究方向为可信人工智能,主要关注智能传播领域相关应用场景。加入天津大学前,她曾任IBM中国研究院高级主任研究员、华为云技术专家。她曾作为华为云模型可信负责人,参与建立首个人工智能云服务安全标准,该成果载入2021年华为公司企业年报。此外,她已发表高水平论文60余篇,拥有授权专利30余项。

王岚君天津大学 研究员报告题目: 视觉生成模型鲁棒性缺陷模式挖掘报告摘要: 随着DALLE-2、Midjourney、Sable Diffusion等成熟的商业模型不断问世,跨模态视觉内容生成技术为内容创作提供了新机遇,但也带来了生成内容安全的挑战。本报告从系统性的回顾针对视觉生成模型的对抗攻击方法出发,揭示视觉生成模型鲁棒性缺陷的三种模式,展示缺陷模式带来的内容生成风险,以及在相应风险防范措施上的思考。个人简介: 王岚君,天津大学新媒体与传播学院研究员,博士生导师,研究方向为可信人工智能,主要关注智能传播领域相关应用场景。加入天津大学前,她曾任IBM中国研究院高级主任研究员、华为云技术专家。她曾作为华为云模型可信负责人,参与建立首个人工智能云服务安全标准,该成果载入2021年华为公司企业年报。此外,她已发表高水平论文60余篇,拥有授权专利30余项。 -

韦星星北京航空航天大学教授报告题目: 多模态大模型可信度评估及增强报告摘要: 本报告旨在介绍多模态大模型的可信度评估及增强方法,主要从可信度评估和增强两个方面展开。首先,针对多模态大模型的可信度评估,从事实性、安全性、鲁棒性、公平性和隐私性五个维度设计了详细的评测实例和工具,全面评估并排序了现有主流的多模态大模型。基于此,提出了名为MultiTrust的可信度评估框架,该框架能够系统地量化和比较不同模型在各个维度上的表现。其次,基于评估结果,进一步探讨了多模态大模型可信度缺失的内在原因,发现当前多模态大模型普遍依赖视觉-语言预训练模块来实现多模态融合。为了提升多模态大模型的可信度,介绍一种基于特征一致性的视觉语言预训练模型增强方法,通过加强不同模态间表征学习的一致性,优化多模态模型的可信度。个人简介: 韦星星现为北京航空航天大学人工智能学院教授,博士生导师,国家级青年人才。主要研究方向为安全可信人工智能,在TPAMI, IJCV和CVPR, ICCV等人工智能领域顶级期刊和会议发表学术论文80余篇(其中TPAMI、IJCV论文10篇),授权发明专利二十余项。多次受邀担任人工智能领域顶级国际会议的程序委员会委员和TPAMI、IJCV等期刊的审稿人。作为负责人主持科技部“新一代人工智能”重大项目课题、国家自然科学基金面上项目、军兵种预研项目、华为/腾讯校企合作项目。研究成果荣获国防技术发明一等奖1项(序3),在国际顶会举办的重要竞赛中获得冠亚军5项,优秀奖5项,被CCTV和环球网报道。

韦星星北京航空航天大学教授报告题目: 多模态大模型可信度评估及增强报告摘要: 本报告旨在介绍多模态大模型的可信度评估及增强方法,主要从可信度评估和增强两个方面展开。首先,针对多模态大模型的可信度评估,从事实性、安全性、鲁棒性、公平性和隐私性五个维度设计了详细的评测实例和工具,全面评估并排序了现有主流的多模态大模型。基于此,提出了名为MultiTrust的可信度评估框架,该框架能够系统地量化和比较不同模型在各个维度上的表现。其次,基于评估结果,进一步探讨了多模态大模型可信度缺失的内在原因,发现当前多模态大模型普遍依赖视觉-语言预训练模块来实现多模态融合。为了提升多模态大模型的可信度,介绍一种基于特征一致性的视觉语言预训练模型增强方法,通过加强不同模态间表征学习的一致性,优化多模态模型的可信度。个人简介: 韦星星现为北京航空航天大学人工智能学院教授,博士生导师,国家级青年人才。主要研究方向为安全可信人工智能,在TPAMI, IJCV和CVPR, ICCV等人工智能领域顶级期刊和会议发表学术论文80余篇(其中TPAMI、IJCV论文10篇),授权发明专利二十余项。多次受邀担任人工智能领域顶级国际会议的程序委员会委员和TPAMI、IJCV等期刊的审稿人。作为负责人主持科技部“新一代人工智能”重大项目课题、国家自然科学基金面上项目、军兵种预研项目、华为/腾讯校企合作项目。研究成果荣获国防技术发明一等奖1项(序3),在国际顶会举办的重要竞赛中获得冠亚军5项,优秀奖5项,被CCTV和环球网报道。

论坛联系人

-

任文琦中山大学renwq3@mail.sysu.edu.cn