学术论坛

- 人工智能生成艺术论坛

- 复杂交通场景感知技术及其前沿应用论坛

- 文字识别与文档智能论坛

- 三维感知与显示技术论坛

- 视觉质量感知与评估前沿论坛

- 流程工业智能视觉感知技术论坛

- 情感计算大模型论坛

- 持续学习的理论与应用论坛

- 智能影像增强与可控内容生成论坛

- 多模态智能模型安全隐患洞察与防护论坛

- 空天探测成像前沿论坛

- 高效视频通信中的语义编码与内容增强论坛

- 智能图像感知微系统论坛

- 面向精神健康促进的具身交互智能研究论坛

- 工业视觉智能检测技术前沿论坛

- 面向具身智能的图像图形技术

- 生物特征识别论坛

- 大模型的表征学习与编码通信论坛

- 大模型复杂场景理解与轻量化应用论坛

- 视频动作理解与生成前沿论坛

- 生物医学成像与人工智能论坛

- 开放环境无人驾驶“感-通-算”前沿技术论坛

- 智能视觉传感信号处理论坛

- NeRF与3DGS智能生成技术探索论坛

- 深空探测人工智能技术论坛

- 生成式视频通信论坛

- 类脑计算、感知和智能论坛

- 多模态大模型应用安全与生成式人工智能监管论坛

- 多模态遥感大模型及应用论坛

- 机器视觉与学习论坛

- 具身智能感知交互论坛

- 规模化与轻量化协同演进技术论坛

- 空间计算前沿技术论坛

- 人脑影像图谱与人工智能论坛

- 低代价高质量信息智能获取论坛

- 工业具身智能感知前沿论坛

视频动作理解与生成前沿论坛

论坛简介

视频动作理解与生成是计算机视觉与多媒体领域的重要研究方向,旨在构建具备通用性、适应性且符合物理世界运动规律的时空感知与生成模型,提升动作理解与生成的准确性和逼真度,实现对动作序列的识别、定位、分析、重建以及生成。在当前飞速发展的大模型驱动下,视频动作理解与生成技术在行为分析、人机交互、运动捕捉等方向的性能不断取得新突破,在个性化训练、医疗康复、智能监控、社交媒体、数字人等领域的应用不断革新。本论坛将邀请视频动作理解与生成领域的专家学者介绍最新前沿技术进展,探讨技术落地应用过程中面临的机遇、挑战与未来发展趋势,提供多元化的学术交流平台。

论坛日程

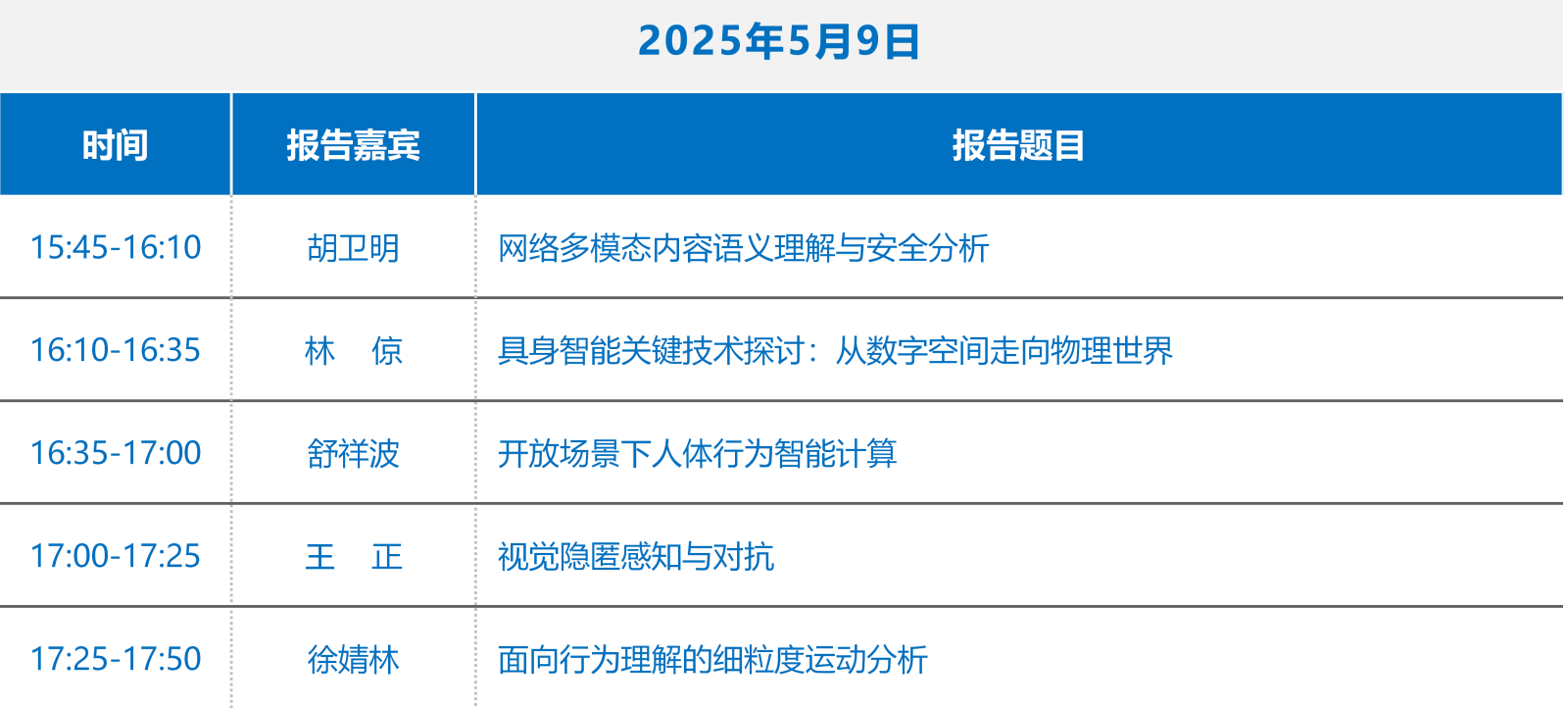

论坛时间:2025年5月9日15:45-17:50

论坛名称:视频动作理解与生成前沿论坛

主持人:彭宇新,徐婧林

论坛主席

彭宇新CSIG理事

彭宇新CSIG理事

北京大学 教授个人简介: 彭宇新,北京大学二级教授、博雅特聘教授、CAAI/CIE/CSIG Fellow、国家杰出青年科学基金获得者、国家万人计划科技创新领军人才、科技部中青年科技创新领军人才、863项目首席专家、中国人工智能产业创新联盟专家委员会主任、中国工程院咨询专家、CSIG副秘书长、奖励委员会副主任、BSIG副理事长。主要研究方向为跨媒体分析、计算机视觉、人工智能。以第一完成人获2016年北京市科学技术奖一等奖和2020年中国电子学会科技进步奖一等奖。主持了863、国家自然基金重点、北京自然基金联合基金重点、发改委专项等40多个项目。发表TPAMI、IJCV、CVPR、NeurIPS、ICML等ACM/IEEE Trans.和CCF A类论文120多篇,获最佳论文奖2次。10次参加由美国国家标准技术局NIST举办的国际评测TRECVID视频搜索比赛,均获第一名。成果应用于国家网信办、公安部、国家广播电视总局等单位以及华为、腾讯、快手、蔚来、美团、中国电信等企业。担任IEEE TCSVT领域高级编委、IEEE TMM等期刊编委。 徐婧林北京科技大学 副教授个人简介: 徐婧林,北京科技大学智能科学与技术学院副教授,北京图象图形学学会理事、副秘书长,中国图象图形学学会青托俱乐部副主席。入选第九届中国科协青年人才托举工程、获2024年CSIG石青云女科学家奖、2022年CSIG优秀博士学位论文奖、2023年中国自动化学会自然科学一等奖(4/5)、2024年CSIG自然科学二等奖(3/5)。主要研究方向为视频动作理解、多模态细粒度分析、三维人体姿态估计与动作生成。已发表ACM/IEEE Trans.和CCF A类论文30余篇。主持国家自然科学基金面上项目、青年基金、北京市自然科学基金面上、中国博士后科学基金面上等项目。获得2023年度BSIG“最美女科技工作者”、2022年西北工业大学优秀博士学位论文等荣誉。担任《Chinese Journal of Electronics》青年编委、《电子与信息学报》编委、《计算机科学》青年编委等。

徐婧林北京科技大学 副教授个人简介: 徐婧林,北京科技大学智能科学与技术学院副教授,北京图象图形学学会理事、副秘书长,中国图象图形学学会青托俱乐部副主席。入选第九届中国科协青年人才托举工程、获2024年CSIG石青云女科学家奖、2022年CSIG优秀博士学位论文奖、2023年中国自动化学会自然科学一等奖(4/5)、2024年CSIG自然科学二等奖(3/5)。主要研究方向为视频动作理解、多模态细粒度分析、三维人体姿态估计与动作生成。已发表ACM/IEEE Trans.和CCF A类论文30余篇。主持国家自然科学基金面上项目、青年基金、北京市自然科学基金面上、中国博士后科学基金面上等项目。获得2023年度BSIG“最美女科技工作者”、2022年西北工业大学优秀博士学位论文等荣誉。担任《Chinese Journal of Electronics》青年编委、《电子与信息学报》编委、《计算机科学》青年编委等。

论坛讲者信息

胡卫明中国科学院自动化研究所 研究员报告题目: 网络多模态内容语义理解与安全分析报告摘要: 针对公共安全大数据多源、异质、时变、隐匿等复杂性特点导致的语义计算复杂、时空线索挖掘复杂和推理过程解释难问题,从模型构建、算法设计、关键技术和系统研制等方面进行网络内容多模态语义理解与安全事件推理方法、技术与系统的研究与开发。在多模态语义理解方面,研究了基于局部文本错误建模的图像文本细粒度语义对齐方法,用1/3预训练数据量即可超越之前最好的方法;研究了基于语义增强在线掩码图像恢复的图像文本预训练方法,效果大幅超越采用原始像素和离线视觉编码器的方法;研究了基于对比式局部排序蒸馏的图文预训练方法,在无微调设置下检索精度优于其他方法;在后预训练设置下,在较小的训练代价下进一步提升模型精度。在大数据多模态知识图谱与推理方面,研究了多模态事件抽取技术、篇章级复杂论元处理技术,利用大模型和外部知识库通过图神经网络学习实体逻辑关系, 在实体、属性、论元、主题等多级粒度计算相似度, 融合实体、论元对事件类型综合判断,并建立了基于多模态知识图谱的敏感视频搜索技术。在系统研发上,开发了网络多媒体数据的采集、建模和风控平台,及时发现各大音视频平台中的违规内容和敏感信息,解决了许多重大实际需求。个人简介: 胡卫明,中国科学院自动化研究所多模态人工智能系统全国重点实验室研究员、博士生导师、视频内容安全研究团队负责人,国家杰出青年科学基金获得者、中组部万人计划科技创新领军人才入选者、科技部中青年科技创新领军人才入选者、人社部百千万人才工程国家级人选、国家有突出贡献中青年专家、享受国务院政府特殊津贴、国家信息安全重点专项项目首席专家,IEEE Trans. on PAMI、ACM Trans. on PML和IEEE Trans. on Cybernetics的Associate Editors。目前研究方向为网络多媒体敏感内容识别等,主持了国家自然科学基金重点项目、国家863重点专项项目、目标导向类课题等四十余项科研项目。已在PAMI、IJCV等国际刊物、国内一级刊物以及NIPS、ICCV等重要国际学术会议上发表论文300余篇,获授权发明专利50余项。带领团队完成的敏感多媒体识别等技术实际应用于一百余家企事业单位,已在实战发挥作用,取得了显著的经济效益和社会效益。以第一完成人获国家自然科学二等奖、北京市科学技术(技术发明类)一等奖、北京市发明专利一等奖和吴文俊人工智能科学技术一等奖。

胡卫明中国科学院自动化研究所 研究员报告题目: 网络多模态内容语义理解与安全分析报告摘要: 针对公共安全大数据多源、异质、时变、隐匿等复杂性特点导致的语义计算复杂、时空线索挖掘复杂和推理过程解释难问题,从模型构建、算法设计、关键技术和系统研制等方面进行网络内容多模态语义理解与安全事件推理方法、技术与系统的研究与开发。在多模态语义理解方面,研究了基于局部文本错误建模的图像文本细粒度语义对齐方法,用1/3预训练数据量即可超越之前最好的方法;研究了基于语义增强在线掩码图像恢复的图像文本预训练方法,效果大幅超越采用原始像素和离线视觉编码器的方法;研究了基于对比式局部排序蒸馏的图文预训练方法,在无微调设置下检索精度优于其他方法;在后预训练设置下,在较小的训练代价下进一步提升模型精度。在大数据多模态知识图谱与推理方面,研究了多模态事件抽取技术、篇章级复杂论元处理技术,利用大模型和外部知识库通过图神经网络学习实体逻辑关系, 在实体、属性、论元、主题等多级粒度计算相似度, 融合实体、论元对事件类型综合判断,并建立了基于多模态知识图谱的敏感视频搜索技术。在系统研发上,开发了网络多媒体数据的采集、建模和风控平台,及时发现各大音视频平台中的违规内容和敏感信息,解决了许多重大实际需求。个人简介: 胡卫明,中国科学院自动化研究所多模态人工智能系统全国重点实验室研究员、博士生导师、视频内容安全研究团队负责人,国家杰出青年科学基金获得者、中组部万人计划科技创新领军人才入选者、科技部中青年科技创新领军人才入选者、人社部百千万人才工程国家级人选、国家有突出贡献中青年专家、享受国务院政府特殊津贴、国家信息安全重点专项项目首席专家,IEEE Trans. on PAMI、ACM Trans. on PML和IEEE Trans. on Cybernetics的Associate Editors。目前研究方向为网络多媒体敏感内容识别等,主持了国家自然科学基金重点项目、国家863重点专项项目、目标导向类课题等四十余项科研项目。已在PAMI、IJCV等国际刊物、国内一级刊物以及NIPS、ICCV等重要国际学术会议上发表论文300余篇,获授权发明专利50余项。带领团队完成的敏感多媒体识别等技术实际应用于一百余家企事业单位,已在实战发挥作用,取得了显著的经济效益和社会效益。以第一完成人获国家自然科学二等奖、北京市科学技术(技术发明类)一等奖、北京市发明专利一等奖和吴文俊人工智能科学技术一等奖。 林倞中山大学 教授报告题目: 具身智能关键技术探讨:从数字空间走向物理世界报告摘要: 具身智能是迈向通用人工智能的必经之路,旨在通过人机物三元融合实现智能体与物理世界的深度交互与协同。本报告深入探讨其核心要素与关键技术路径。首先探讨物理规则嵌入的具身世界模型,通过精准建模真实世界,为智能体提供动态感知与决策的基础。其次,聚焦具身感知、交互与任务规划的深度融合,强调通过多模态空间推理与实时交互,实现人、机器人与物理环境的高效协同。进一步,探索具身智能体的虚实迁移框架,利用虚拟环境的高效训练与现实世界的验证,提升智能体的适应性与泛化能力。最后,构建国产自主可控的具身智能生态体系,推动核心技术自主创新与产业应用落地。个人简介: 林倞,IEEE/IAPR Fellow,鹏城国家实验室多智能体与具身智能研究所所长、中山大学二级教授、国家杰青、国家重大项目首席科学家;在多模态认知计算、生成式模型、具身交互与学习等领域形成一系列突破创新成果;发表论文400余篇,谷歌引用4万余次,5次获得国际会议/期刊的最佳论文奖;获省级自然科学一等奖、吴文俊人工智能奖、中国图象图形学学会科技一等奖,带领团队坚持产学研结合的科技创新,曾任商汤科技研究院执行院长。

林倞中山大学 教授报告题目: 具身智能关键技术探讨:从数字空间走向物理世界报告摘要: 具身智能是迈向通用人工智能的必经之路,旨在通过人机物三元融合实现智能体与物理世界的深度交互与协同。本报告深入探讨其核心要素与关键技术路径。首先探讨物理规则嵌入的具身世界模型,通过精准建模真实世界,为智能体提供动态感知与决策的基础。其次,聚焦具身感知、交互与任务规划的深度融合,强调通过多模态空间推理与实时交互,实现人、机器人与物理环境的高效协同。进一步,探索具身智能体的虚实迁移框架,利用虚拟环境的高效训练与现实世界的验证,提升智能体的适应性与泛化能力。最后,构建国产自主可控的具身智能生态体系,推动核心技术自主创新与产业应用落地。个人简介: 林倞,IEEE/IAPR Fellow,鹏城国家实验室多智能体与具身智能研究所所长、中山大学二级教授、国家杰青、国家重大项目首席科学家;在多模态认知计算、生成式模型、具身交互与学习等领域形成一系列突破创新成果;发表论文400余篇,谷歌引用4万余次,5次获得国际会议/期刊的最佳论文奖;获省级自然科学一等奖、吴文俊人工智能奖、中国图象图形学学会科技一等奖,带领团队坚持产学研结合的科技创新,曾任商汤科技研究院执行院长。 舒祥波南京理工大学 教授报告题目: 开放场景下人体行为智能计算报告摘要: 开放场景中,由于分散数据利用率低、监督训练样本量少、行为语义复杂性高等因素,给人体行为智能计算带来了新的挑战。基于此,本报告将探讨多样化开放场景下的人体行为智能计算研究任务,重点介绍课题组近年在边云协同的模型预训练与微调、数据受限的人体行为鲁棒表征、细粒度/多粒度行为分析与推理等方面的技术同,并简要介绍相关技术的推广应用。个人简介: 舒祥波,南京理工大学计算机科学与工程学院/人工智能学院教授、社会安全信息感知与系统工信部重点实验室副主任、国家优秀青年基金获得者、江苏省杰出青年基金获得者。近年主要研究兴趣为人体行为计算,在TPAMI、CVPR、ICCV、ACM MM等期刊/会议上发表论文100余篇,其中ESI高被引论文8篇;获中国电子学会自然科学一等奖、ACM MM 2015最佳论文提名、MMM 2016最佳学生论文奖、江苏省优博、中国人工智能学会优博、2024年度江苏自然科学百篇优秀学术成果论文;入选全球前2%顶尖科学家(2021-2024年连续4年入选);承担国家自然科学重点/面上/青年项目、国家重点研发课题、国防基础科研项目等国家级项目。担任CSIG青工委副秘书长,以及IEEE TNNLS、IEEE TCSVT、Pattern Recognition等期刊编委。

舒祥波南京理工大学 教授报告题目: 开放场景下人体行为智能计算报告摘要: 开放场景中,由于分散数据利用率低、监督训练样本量少、行为语义复杂性高等因素,给人体行为智能计算带来了新的挑战。基于此,本报告将探讨多样化开放场景下的人体行为智能计算研究任务,重点介绍课题组近年在边云协同的模型预训练与微调、数据受限的人体行为鲁棒表征、细粒度/多粒度行为分析与推理等方面的技术同,并简要介绍相关技术的推广应用。个人简介: 舒祥波,南京理工大学计算机科学与工程学院/人工智能学院教授、社会安全信息感知与系统工信部重点实验室副主任、国家优秀青年基金获得者、江苏省杰出青年基金获得者。近年主要研究兴趣为人体行为计算,在TPAMI、CVPR、ICCV、ACM MM等期刊/会议上发表论文100余篇,其中ESI高被引论文8篇;获中国电子学会自然科学一等奖、ACM MM 2015最佳论文提名、MMM 2016最佳学生论文奖、江苏省优博、中国人工智能学会优博、2024年度江苏自然科学百篇优秀学术成果论文;入选全球前2%顶尖科学家(2021-2024年连续4年入选);承担国家自然科学重点/面上/青年项目、国家重点研发课题、国防基础科研项目等国家级项目。担任CSIG青工委副秘书长,以及IEEE TNNLS、IEEE TCSVT、Pattern Recognition等期刊编委。 王正武汉大学 教授报告题目: 视觉隐匿感知与物理对抗报告摘要: 机器通过相机和计算机视觉技术感知和理解物理世界,在现代科技中扮演着至关重要的角色。计算机视觉技术使得机器能够捕捉并分析来自环境中的图像和视频数据,从而获得对周围世界的理解。然而,除了处理和识别基本的可见视觉信息外,仍有大量的隐匿信息和意图隐藏在这些视觉数据背后。如何挖掘和识别这些隐藏的信息,成为当前研究中的重要课题。与此同时,随着隐私保护意识的提高,如何隐匿和防护敏感信息成为另一个不可忽视的挑战。本报告将详细介绍我们在“感知隐藏信息”和“隐匿敏感信息”方面的研究进展。个人简介: 王正,武汉大学计算机学院/国家多媒体软件工程技术研究中心教授,计算机实验教学中心主任,国家级人才计划青年项目(海外)入选者。曾任新加坡国立大学高级访问学者,东京大学助理教授,日本文部科学省卓越研究员,日本学术振兴会外国人特别研究员,获中国留日同学会最优秀青年学者奖。主要研究方向为多媒体内容分析、社会安全治理,在CCF-A类期刊和会议发表论文90余篇,获PCM 2014最佳论文奖,ICME 2021最佳论文提名,SCI一区期刊International Journal of Intelligent Systems封面论文。任 IEEE电路与系统学会(CAS)多媒体系统与应用技术委员会(MSA TC)委员,CCF-A类期刊IEEE TIP副编辑。指导学生获得“挑战杯”竞赛黑科技专项赛道、中国研究生人工智能创新大赛、中国研究生网络安全创新大赛等学科竞赛全国一等奖,中国国际大学生创新大赛全国银奖、铜奖。

王正武汉大学 教授报告题目: 视觉隐匿感知与物理对抗报告摘要: 机器通过相机和计算机视觉技术感知和理解物理世界,在现代科技中扮演着至关重要的角色。计算机视觉技术使得机器能够捕捉并分析来自环境中的图像和视频数据,从而获得对周围世界的理解。然而,除了处理和识别基本的可见视觉信息外,仍有大量的隐匿信息和意图隐藏在这些视觉数据背后。如何挖掘和识别这些隐藏的信息,成为当前研究中的重要课题。与此同时,随着隐私保护意识的提高,如何隐匿和防护敏感信息成为另一个不可忽视的挑战。本报告将详细介绍我们在“感知隐藏信息”和“隐匿敏感信息”方面的研究进展。个人简介: 王正,武汉大学计算机学院/国家多媒体软件工程技术研究中心教授,计算机实验教学中心主任,国家级人才计划青年项目(海外)入选者。曾任新加坡国立大学高级访问学者,东京大学助理教授,日本文部科学省卓越研究员,日本学术振兴会外国人特别研究员,获中国留日同学会最优秀青年学者奖。主要研究方向为多媒体内容分析、社会安全治理,在CCF-A类期刊和会议发表论文90余篇,获PCM 2014最佳论文奖,ICME 2021最佳论文提名,SCI一区期刊International Journal of Intelligent Systems封面论文。任 IEEE电路与系统学会(CAS)多媒体系统与应用技术委员会(MSA TC)委员,CCF-A类期刊IEEE TIP副编辑。指导学生获得“挑战杯”竞赛黑科技专项赛道、中国研究生人工智能创新大赛、中国研究生网络安全创新大赛等学科竞赛全国一等奖,中国国际大学生创新大赛全国银奖、铜奖。 徐婧林北京科技大学 副教授报告题目: 面向行为理解的细粒度运动分析报告摘要: 围绕真实世界的细粒度运动分析难题:质量差异细微难评价、时空边界模糊难定位、关节部位遮挡难估计,展开如下研究:细粒度动作质量评价、细粒度动作定位、三维人体姿态估计。这3个研究内容从二维空间单人场景出发,逐步拓展到二维空间多人场景,进一步深入到三维空间的人体姿态估计,形成了一套递进的细粒度运动分析技术链条,为行为理解领域提供了新的技术支撑,广泛应用于体育、医疗、教育等领域。个人简介: 徐婧林,北京科技大学智能科学与技术学院副教授,北京图象图形学学会理事、副秘书长,中国图象图形学学会青托俱乐部副主席。入选第九届中国科协青年人才托举工程、获2024年CSIG石青云女科学家奖、2022年CSIG优秀博士学位论文奖、2023年中国自动化学会自然科学一等奖(4/5)、2024年CSIG自然科学二等奖(3/5)。主要研究方向为视频动作理解、多模态细粒度分析、三维人体姿态估计与动作生成。已发表ACM/IEEE Trans.和CCF A类论文30余篇。主持国家自然科学基金面上项目、青年基金、北京市自然科学基金面上、中国博士后科学基金面上等项目。获得2023年度BSIG“最美女科技工作者”、2022年西北工业大学优秀博士学位论文等荣誉。担任《Chinese Journal of Electronics》青年编委、《电子与信息学报》编委、《计算机科学》青年编委等。

徐婧林北京科技大学 副教授报告题目: 面向行为理解的细粒度运动分析报告摘要: 围绕真实世界的细粒度运动分析难题:质量差异细微难评价、时空边界模糊难定位、关节部位遮挡难估计,展开如下研究:细粒度动作质量评价、细粒度动作定位、三维人体姿态估计。这3个研究内容从二维空间单人场景出发,逐步拓展到二维空间多人场景,进一步深入到三维空间的人体姿态估计,形成了一套递进的细粒度运动分析技术链条,为行为理解领域提供了新的技术支撑,广泛应用于体育、医疗、教育等领域。个人简介: 徐婧林,北京科技大学智能科学与技术学院副教授,北京图象图形学学会理事、副秘书长,中国图象图形学学会青托俱乐部副主席。入选第九届中国科协青年人才托举工程、获2024年CSIG石青云女科学家奖、2022年CSIG优秀博士学位论文奖、2023年中国自动化学会自然科学一等奖(4/5)、2024年CSIG自然科学二等奖(3/5)。主要研究方向为视频动作理解、多模态细粒度分析、三维人体姿态估计与动作生成。已发表ACM/IEEE Trans.和CCF A类论文30余篇。主持国家自然科学基金面上项目、青年基金、北京市自然科学基金面上、中国博士后科学基金面上等项目。获得2023年度BSIG“最美女科技工作者”、2022年西北工业大学优秀博士学位论文等荣誉。担任《Chinese Journal of Electronics》青年编委、《电子与信息学报》编委、《计算机科学》青年编委等。

论坛联系人

- 徐婧林北京科技大学xujinglin@ustb.edu.cn